12月22日,由南方都市报个人信息保护研究中心联合清华大学人工智能国际治理研究院、人工智能治理研究中心(清华大学)主办的“2022啄木鸟数据治理论坛”在北京举行。

论坛上,南都人工智能伦理课题组在会上发布了《算法应用与治理观察报告(2022)》(以下简称“报告”)。

01

企业公开算法 常与遭遇舆情关联

目前,全球已经有160多个国家出台了人工智能的伦理原则或指南,国际有关组织制定的人工智能标准进入“井喷期”。报告指出,国际人工智能治理工作正在加速可操作化,尤其表现在数据治理、算法治理、网络治理、监管政策等方面。

通过梳理发现,我国对于算法治理的法规出台呈现出从单独条款到专门立法的特点。

过去几年,算法相关条款多散见于《电子商务法》《个人信息保护法》《反垄断法》《网络信息内容生态治理规定》《网络音视频信息服务管理规定》等法规中。今年3月,我国第一个专门针对算法推荐的部门规章——《互联网信息服务算法推荐管理规定》(下称《算法推荐规定》)正式实施,《互联网信息服务深度合成管理规定》也将于明年1月10日起施行。

为了响应法规,不少国内企业公开了主要的算法。当前国内企业的算法公开整体可分为两种渠道:一种是在国家统一的互联网信息服务算法备案系统(下称“备案系统”)上进行备案,另一种则是在“自家平台”上主动公开。

据统计,目前在备案系统上备案的算法共有100条,涉及42家企业。整体而言,备案算法均呈现出较为晦涩简略的内容,鲜少出现具体数字、比例或计算公式的特点。

国内企业也会在自身平台上主动公开算法,但主动公开算法的企业数量较少,渠道较为分散,且多在舆情事件发生之后公开。比如2020年9月8日,一篇文章《外卖骑手 困在系统里》通过探讨算法下平台与骑手之间的关系,一度将外卖平台推上风口浪尖。

一年后,美团在官方公众号上详细介绍了“预估到达时间”算法和“订单分配”算法的基本逻辑和运行原理。饿了么则在今年发布的《2022蓝骑士发展与保障报告》中披露了当前本平台实行的“禁止最严算法”的规则。

02

国内企业算法公开 仅一成受访者“满意”

为了解公众对日常生活中常用算法的了解程度和态度,报告发布了一份算法治理问卷,共回收1292份。

报告里的问卷调查显示,有43.65%的受访者认为“比较了解”算法,37.69%的受访者表示对算法“不太了解”,而对算法“非常了解”或“完全不了解”的受访者一共不到两成。

在谈到算法对个人的使用体验影响时,有33.05%的受访者表示“说不清楚”,认为“没有变化”的占比9.37%。约一成受访者明确表达“变差了”。结合地区看,这部分认为算法带来不好体验的人群中,多来自北上广深。

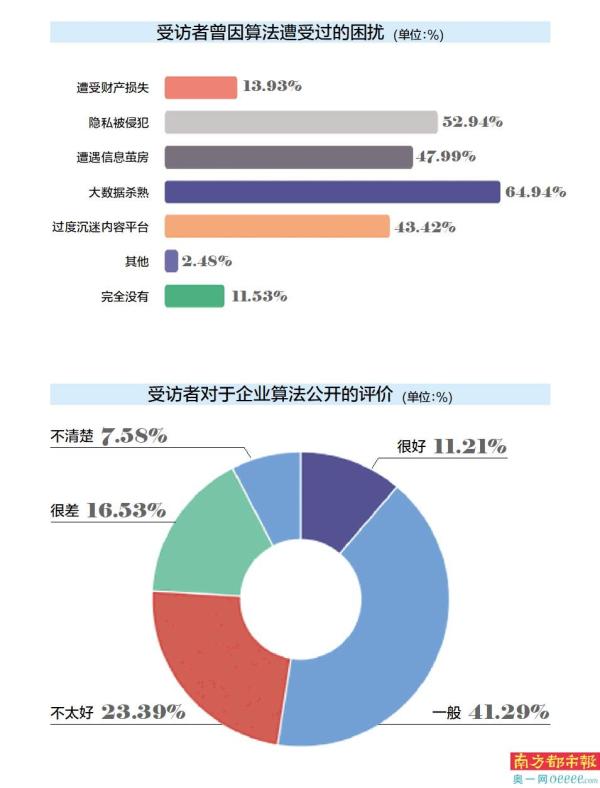

问卷结果还显示,“大数据杀熟”是最多受访者们经历过的算法困扰——有64.94%的受访者都认为自己曾真实遭遇过大数据杀熟,其次为隐私侵犯、信息茧房和因过度沉迷内容平台感到困扰等情况。

在很多应用场景中,算法常常和“黑箱”一词联系起来。很多受访者认为当前企业在算法解释上做得差强人意,仅有约一成的受访者认为做得很好,而态度为偏向负面的“一般”“不太好”“很差”的受访者则超过八成。

对于未来的算法治理,73.61%的受访者认为应该在现有的法律基础上,继续出台相关法律法规或标准规范,同时应当加大对算法的监管和备案审核力度。62.46%受访者认为需要强制企业按照一定标准进行算法公开,还有半数左右的受访者认为应当更多关注算法造成的歧视、偏见问题,或建立类似12315的专门投诉机制。

03

细化算法公开标准 弥合企业与公众鸿沟

将问卷调查结果与从企业方了解到的情况对比,发现企业与公众主要在与算法相关的两个问题上存在分歧——一个是“算法到底应该公开到何种程度”,另一个则是“安全”与“效率”的冲突。

对于前者,问卷调查显示,约有64%的受访者认为企业在算法解释上做得“一般”或“不太好”。但多家企业表示,真正投入运行的代码模型量级太大,细节本就难以深挖,此外,由于持续运行的代码通常又会有较为频繁的更新,所以无法做到“公开最新代码”。另一方面,比起主动去定义算法公开的内容,企业更希望遵循既定的规则,减少合规风险,而不是“既做运动员又做裁判员”。

对于这一问题,报告调查后发现,首先由于理解算法的门槛相对较高,社交平台上的广泛讨论进一步放大了对算法缺少认识的人群的恐惧心理,导致公众和企业之间存在信息差,难以达成一致;其次,公众更希望企业的算法解释可以直接对应到某个具体场景或给出具体比例,但从企业目前公开的算法来看,基本只是说明了大致原理,连列出详细公式的都寥寥无几,如此宽泛的算法解释自然难以对应多样的应用场景。

报告建议,在现有算法相关法规的基础上,未来由政府推动建立统一的算法公开标准,明确算法如何公开、公开到什么程度,以分层次的算法解释为中心促进算法适度透明。同时,也应综合考虑算法的应用场景、处理数据的风险程度、算法使用的正向效益和可能的社会危害等多种维度,进一步细化算法监管的分类分级,落实多层次场景化、精细化的分级分类的算法治理工作。

而对于“安全”与“效率”的矛盾问题,问卷中有超过六成的用户认为企业在开发算法时最应优先追求“安全”因素,而企业天然追求效率,双方对于算法应用的期待自然存在差异。

对此,报告认为,公众因为对算法原理缺乏了解,又不熟悉相关法规,在遭遇算法引发的问题时难以应对,无法保障自身合法权益,所以对一些算法甚至企业产生了抗拒和恐惧心理。而部分企业也的确存在追求效率而不顾安全的行为。

为此报告建议,政府、媒体应加大科普力度,持续开展日常性算法教育,帮助公众提高对算法服务的认知能力和自我保护能力,消除信息不对称以及由此引发的恐惧心理,不断提升公众的算法素养。企业方在开发算法时,应充分考虑算法可能带来的负面效应,注重与保护公共利益之间的平衡,并加强算法信息披露。