奥运AI手语主播、虚拟偶像、换脸明星……这些应用背后的深度合成技术发展到了什么阶段?大火的“元宇宙”和深度合成的关系是什么?深度合成监管面临怎样的技术和伦理难题?日前,在北京举办的第二次长城工程科技会议“人工智能的安全可控与伦理治理”分论坛上,《深度合成应用十大趋势报告》(2022)发布。围绕深度合成带来的伦理问题,多位专家在会上进行了探讨。

深度合成内容关注度指数增长

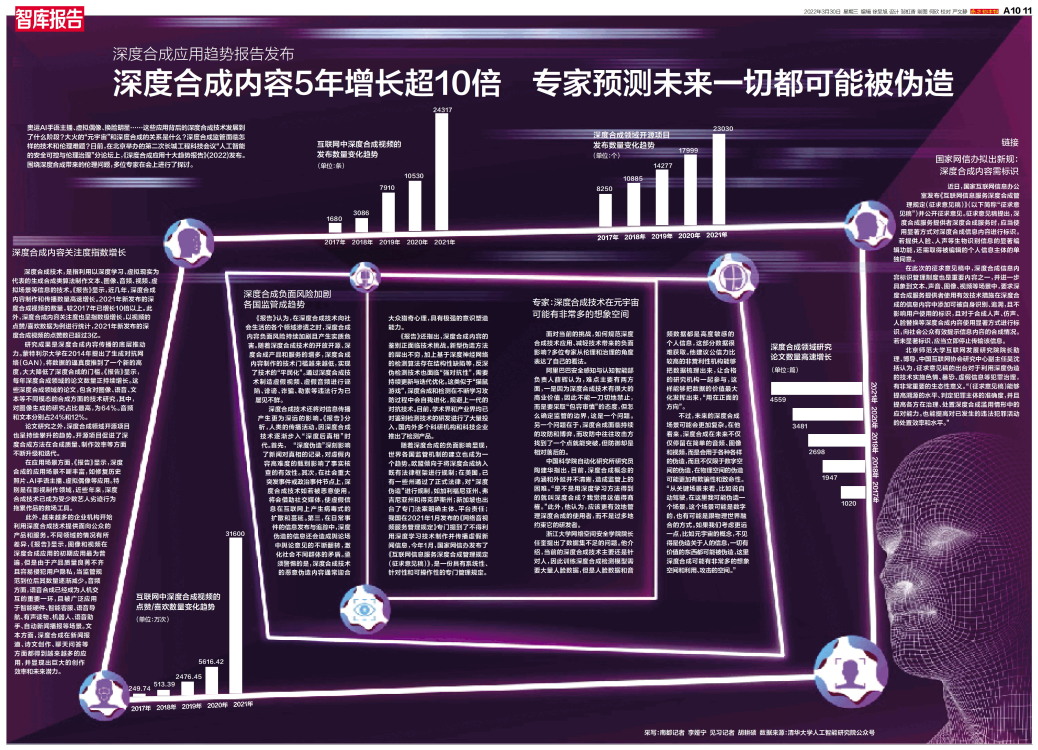

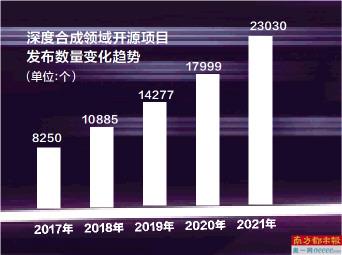

深度合成技术,是指利用以深度学习、虚拟现实为代表的生成合成类算法制作文本、图像、音频、视频、虚拟场景等信息的技术。《报告》显示,近几年,深度合成内容制作和传播数量高速增长。2021年新发布的深度合成视频的数量,较2017年已增长10倍以上。此外,深度合成内容关注度也呈指数级增长,以视频的点赞/喜欢数据为例进行统计,2021年新发布的深度合成视频的点赞数已超过3亿。

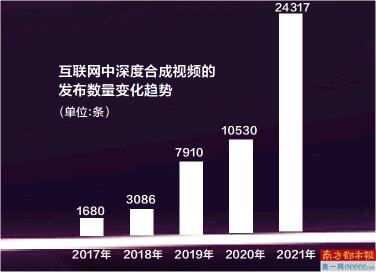

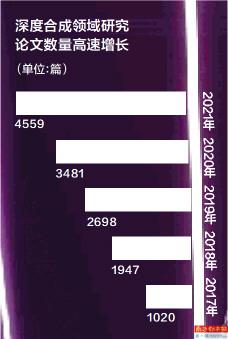

研究成果是深度合成内容传播的底层推动力。蒙特利尔大学在2014年提出了生成对抗网络(GAN),将数据的逼真度推到了一个新的高度,大大降低了深度合成的门槛。《报告》显示,每年深度合成领域的论文数量正持续增长。这些深度合成领域的论文,包含对图像、语音、文本等不同模态的合成方面的技术研究,其中,对图像生成的研究占比最高,为64%。音频和文本分别占24%和12%。

论文研究之外,深度合成领域开源项目也呈持续攀升的趋势。开源项目促进了深度合成方法在合成质量、制作效率等方面不断升级和迭代。

在应用场景方面,《报告》显示,深度合成的应用场景不断丰富,如修复历史照片、AI手语主播、虚拟偶像等应用。特别是在影视制作领域,近些年来,深度合成技术已成为受少数艺人劣迹行为拖累作品的救场工具。

此外,越来越多的企业机构开始利用深度合成技术提供面向公众的产品和服务。不同领域的情况有所差异,《报告》显示,图像和视频在深度合成应用的初期应用最为普遍,但是由于产品质量良莠不齐且容易侵犯用户隐私,当监管规范到位后其数量逐渐减少。音频方面,语音合成已经成为人机交互的重要一环,且被广泛应用于智能硬件、智能客服、语音导航、有声读物、机器人、语音助手、自动新闻播报等场景。文本方面,深度合成在新闻报道、诗文创作、聊天问答等方面都得到越来越多的应用,并显现出巨大的创作效率和未来潜力。

深度合成负面风险加剧 各国监管成趋势

《报告》认为,在深度合成技术向社会生活的各个领域渗透之时,深度合成内容负面风险持续加剧且产生实质危害。随着深度合成技术的开放开源、深度合成产品和服务的增多,深度合成内容制作的技术门槛越来越低,实现了技术的“平民化”。通过深度合成技术制造虚假视频、虚假音频进行诬陷、诽谤、诈骗、勒索等违法行为已屡见不鲜。

深度合成技术还将对信息传播产生更为深远的影响。《报告》分析,人类的传播活动,因深度合成技术逐渐步入“深度后真相”时代。首先, “深度伪造”深刻影响了新闻对真相的记录,对虚假内容高难度的甄别影响了事实核查的有效性。其次,在社会重大突发事件或政治事件节点上,深度合成技术如若被恶意使用,将会借助社交媒体,使虚假信息在互联网上产生病毒式的扩散和蔓延。第三,在日常事件的信息发布与追踪中,深度伪造的信息还会造成舆论场中舆论意见的不断翻转,激化社会不同群体的矛盾。亟须警惕的是,深度合成技术的恶意伪造内容通常迎合大众猎奇心理,具有极强的意识塑造能力。

《报告》还指出,深度合成内容的鉴别正面临技术挑战。新型伪造方法的层出不穷,加上基于深度神经网络的检测算法存在结构性缺陷等,反深伪检测技术也面临“强对抗性”,需要持续更新与迭代优化。这类似于“猫鼠游戏”,深度合成和检测在不断学习攻防过程中会自我进化,规避上一代的对抗技术。目前,学术界和产业界均已对鉴别检测技术的研发进行了大量投入,国内外多个科研机构和科技企业推出了检测产品。

随着深度合成的负面影响显现,世界各国监管机制的建立也成为一个趋势。欧盟倾向于将深度合成纳入既有法律框架进行规制;在美国,已有一些州通过了正式法律,对“深度伪造”进行规制,如加利福尼亚州、弗吉尼亚州和得克萨斯州;新加坡也出台了专门法案明确主体、平台责任;我国在2021年1月发布的《网络音视频服务管理规定》专门提到了不得利用深度学习技术制作并传播虚假新闻信息,今年1月,国家网信办发布了《互联网信息服务深度合成管理规定(征求意见稿)》,是一份具有系统性、针对性和可操作性的专门管理规定。

专家:深度合成技术在元宇宙可能有非常多的想象空间

面对当前的挑战,如何规范深度合成技术应用、减轻技术带来的负面影响?多位专家从伦理和治理的角度表达了自己的看法。

阿里巴巴安全感知与认知智能部负责人薛辉认为,难点主要有两方面,一是因为深度合成技术有很大的商业价值,因此不能一刀切地禁止,而是要采取“包容审慎”的态度,但怎么确定监管的边界,这是一个问题。另一个问题在于,深度合成面临持续的攻防和博弈,而攻防中往往攻击方找到了一个点就能突破,但防御却是相对落后的。

中国科学院自动化研究所研究员陶建华指出,目前,深度合成概念的内涵和外延并不清晰,造成监管上的困难。“是不是用深度学习方法得到的就叫深度合成?我觉得这值得商榷。”此外,他认为,应该更有效地管理深度合成的使用者,而不是过多地约束它的研发者。

浙江大学网络空间安全学院院长任奎提出了数据集不足的问题。他介绍,当前的深度合成技术主要还是针对人,因此训练深度合成检测模型需要大量人脸数据,但是人脸数据和音频数据都是高度敏感的个人信息,这部分数据很难获取。他建议公信力比较高的非营利性机构能够把数据梳理出来,让合格的研究机构一起参与,这样能够把数据的价值最大化发挥出来,“用在正面的方向”。

不过,未来的深度合成场景可能会更加复杂。在他看来,深度合成在未来不仅仅停留在简单的音频、图像和视频,而是会用于各种各样的伪造,而且不仅限于数字空间的伪造,在物理空间的伪造可能更加有欺骗性和致命性。“从关键场景来看,比如说自动驾驶,在这里我可能伪造一个场景,这个场景可能是数字的,也有可能是跟物理世界融合的方式。如果我们考虑更远一点,比如元宇宙的概念,不见得是伪造关于人的信息,一切有价值的东西都可能被伪造,这里深度合成可能有非常多的想象空间和利用、攻击的空间。”

面对当前的挑战,如何规范深度合成技术应用、减轻技术带来的负面影响?多位专家从伦理和治理的角度表达了自己的看法。

阿里巴巴安全感知与认知智能部负责人薛辉认为,难点主要有两方面,一是因为深度合成技术有很大的商业价值,因此不能一刀切地禁止,而是要采取“包容审慎”的态度,但怎么确定监管的边界,这是一个问题。另一个问题在于,深度合成面临持续的攻防和博弈,而攻防中往往攻击方找到了一个点就能突破,但防御却是相对落后的。

中国科学院自动化研究所研究员陶建华指出,目前,深度合成概念的内涵和外延并不清晰,造成监管上的困难。“是不是用深度学习方法得到的就叫深度合成?我觉得这值得商榷。”此外,他认为,应该更有效地管理深度合成的使用者,而不是过多地约束它的研发者。

浙江大学网络空间安全学院院长任奎提出了数据集不足的问题。他介绍,当前的深度合成技术主要还是针对人,因此训练深度合成检测模型需要大量人脸数据,但是人脸数据和音频数据都是高度敏感的个人信息,这部分数据很难获取。他建议公信力比较高的非营利性机构能够把数据梳理出来,让合格的研究机构一起参与,这样能够把数据的价值最大化发挥出来,“用在正面的方向”。

不过,未来的深度合成场景可能会更加复杂。在他看来,深度合成在未来不仅仅停留在简单的音频、图像和视频,而是会用于各种各样的伪造,而且不仅限于数字空间的伪造,在物理空间的伪造可能更加有欺骗性和致命性。“从关键场景来看,比如说自动驾驶,在这里我可能伪造一个场景,这个场景可能是数字的,也有可能是跟物理世界融合的方式。如果我们考虑更远一点,比如元宇宙的概念,不见得是伪造关于人的信息,一切有价值的东西都可能被伪造,这里深度合成可能有非常多的想象空间和利用、攻击的空间。”

链接

国家网信办拟出新规:深度合成内容需标识

近日,国家互联网信息办公室发布《互联网信息服务深度合成管理规定(征求意见稿)》(以下简称“征求意见稿”)并公开征求意见。征求意见稿提出,深度合成服务提供者深度合成服务时,应当使用显著方式对深度合成信息内容进行标识。若提供人脸、人声等生物识别信息的显著编辑功能,还需取得被编辑的个人信息主体的单独同意。

在此次的征求意见稿中,深度合成信息内容标识管理制度也是重要内容之一,并进一步具象到文本、声音、图像、视频等场景中,要求深度合成服务提供者使用有效技术措施在深度合成的信息内容中添加可被自身识别、追溯,且不影响用户使用的标识,且对于合成人声、仿声、人脸替换等深度合成内容使用显著方式进行标识,向社会公众有效提示信息内容的合成情况。若未显著标识,应当立即停止传输该信息。

北京师范大学互联网发展研究院院长助理、博导、中国互联网协会研究中心副主任吴沈括认为,征求意见稿的出台对于利用深度伪造的技术实施色情、暴恐、虚假信息等犯罪治理,有非常重要的生态性意义。“(征求意见稿)能够提高溯源的水平、判定犯罪主体的准确度,并且提高各方在治理、处置深度合成滥用情形中的应对能力。也能提高对已发生的违法犯罪活动的处置效率和水平。”

采写:南都记者 李娅宁 见习记者 胡耕硕 数据来源:清华大学人工智能研究院公众号